AirPodsの「ライブ翻訳」機能が日本語に対応しました。AirPodsを耳に装着するだけで、英語の会話が日本語に翻訳されて聞こえてくる──まるでドラえもんの「ほんやくコンニャク」のような未来が、ついに現実のものとなったんです。

しかし、SNSやレビュー記事を見ると、賛否両論の声が目立ちます。「すごく便利!」という意見もあれば、「思ったより使えない」という声も。実際のところ、どうなのでしょうか。

そこでRingo Magazineでは、実際の英語音声やネイティブスピーカーとの会話で、このライブ翻訳機能を徹底的に試してみました。今回は、良い点だけでなく、時間ラグや翻訳ミスなどの問題点も含めて、正直にレポートします。

ライブ翻訳とは?|まず基本を理解する

機能の概要

ライブ翻訳は、AirPodsとiPhoneを組み合わせて使う、リアルタイム音声翻訳機能です。相手が話す外国語を瞬時に日本語に翻訳し、AirPodsから音声で聞くことができます。

使い方の流れ

- 相手が英語(または他の対応言語)で話す

- iPhoneのマイクとAirPodsのマイクが音声を拾う

- iPhone上のApple IntelligenceがAIで翻訳処理

- 翻訳された日本語がAirPodsから音声で流れる

- iPhoneの画面にはテキストも表示される

重要なのは、すべての処理がiPhone内で完結する「オンデバイス処理」である点。クラウドにデータを送らないため、会話内容が外部に漏れる心配がありません。

対応機種と必要な環境

必要なiPhone

- iPhone 15 Pro / 15 Pro Max

- iPhone 16シリーズ全モデル(16、16e、16 Pro、16 Pro Max)

- iPhone 17シリーズ全モデル(2025年秋発売予定)

- iOS 26.1以降にアップデート済み

- Apple Intelligenceをオンにする

対応するAirPods

- AirPods Pro 3

- AirPods Pro 2(最新ファームウェア必須)

- AirPods 4(アクティブノイズキャンセリング搭載モデルのみ)

注意が必要なのは、AirPods 4には「ANC(ノイズキャンセリング)なしモデル」と「ANCありモデル」の2種類があり、ライブ翻訳に対応するのはANCありモデルのみという点です。

AirPodsの最新モデルに関する新機能・特徴まとめ

▶︎ 最新AirPods 4の新機能や特徴を徹底ガイド

▶︎ 最新AirPods Pro 3の新機能や特徴を徹底ガイド

▶︎ 最新AirPods Maxの新機能や特徴を徹底ガイド

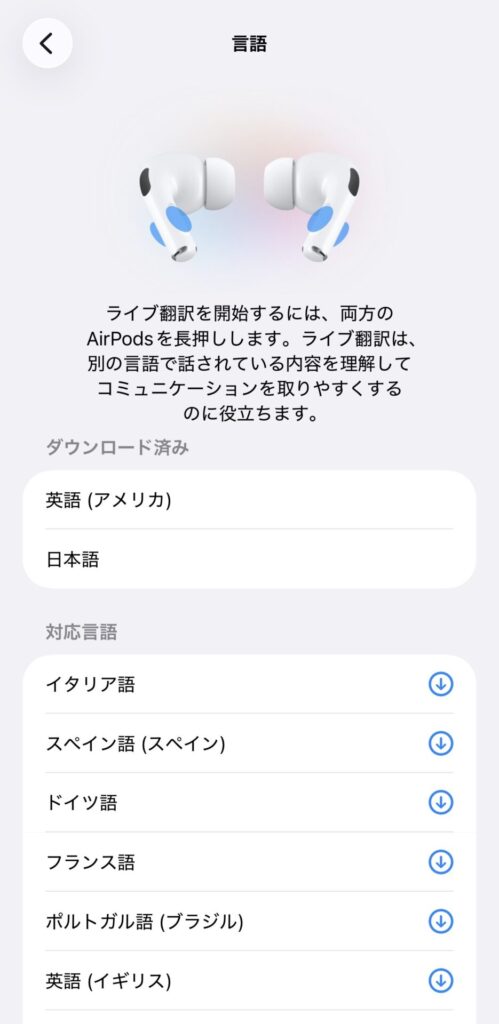

対応言語(2025年12月現在)

| 言語 | 地域 |

|---|---|

| 英語 | アメリカ、イギリス |

| 日本語 | – |

| 中国語 | 普通話(簡体字・繁体字) |

| 韓国語 | – |

| フランス語 | フランス |

| ドイツ語 | ドイツ |

| イタリア語 | – |

| スペイン語 | スペイン |

| ポルトガル語 | ブラジル |

注目すべきは、同じ言語でも地域によって対応が異なる点です。たとえば英語はアメリカとイギリスに対応していますが、オーストラリアやカナダの英語は明記されていません(実際には使えますが精度は保証外)。

実際に使ってみた|英語音声の翻訳体験

準備:言語データのダウンロード

使い始める前に、翻訳する言語のデータをダウンロードする必要があります。

- 「設定」→「AirPods」→「翻訳」→「言語」を開く

- 使いたい言語(例:英語(アメリカ))をタップ

- ダウンロード完了まで待つ(英語は約700MB)

- AirPodsの両耳のステムを長押しする

この言語データは意外と大きく、中国語(簡体字)だと約800MBあります。複数の言語をダウンロードするとiPhoneのストレージを圧迫するので、注意が必要です。

ただし、一度ダウンロードすれば、オフラインでも翻訳機能が使えるのは大きなメリット。海外旅行先でWi-Fiがない場所でも安心して使えます。

テスト1:YouTubeの英語ニュースを翻訳

まず、CNNの英語ニュース動画で試してみました。

セッティング

- YouTubeアプリでニュース動画を再生

- iPhoneの「翻訳」アプリを開く

- 「ライブ」タブで「相手の言語:英語(アメリカ)」「あなたの言語:日本語」を選択

- AirPodsを装着して「翻訳を開始」をタップ

良かった点

ニュースキャスターの発話は比較的ゆっくりで明瞭なため、翻訳精度は予想以上に高かったです。「今日、大統領は新しい法案に署名しました」といった基本的な文は、ほぼ正確に日本語で聞き取れました。

特に驚いたのは、専門用語の翻訳精度。「inflation rate(インフレ率)」「unemployment(失業率)」「GDP(国内総生産)」といった経済用語も、適切に日本語に訳されていました。

気になった点

しかし、問題もありました。最も顕著だったのは時間ラグです。

ニュースキャスターが一文を話し終えてから、翻訳が聞こえ始めるまでに約2〜3秒の遅延があります。これは英語と日本語の語順の違いによるもので、避けられない問題のようです。

たとえば英語は「I went to the store yesterday(私は行った、店に、昨日)」という語順ですが、日本語は「私は昨日、店に行った」となります。このため、文末まで聞かないと正確な翻訳ができないのです。

結果

- ニュースキャスター:「The president signed…」(大統領が署名した…)

- 2秒の沈黙

- AirPods:「今日、大統領は…」

この2〜3秒のタイムラグは、慣れるまで違和感がありました。

テスト2:TEDトークで長文翻訳に挑戦

次に、より難易度の高いTEDトークを試しました。TEDの講演は複雑な構文と長い文章が特徴です。

セッティング

- TEDアプリで15分ほどのプレゼンテーションを選択

- 同じくライブ翻訳を起動

結果:長文になると精度が落ちる

短い文(10〜15語程度)なら問題ありませんが、長い文になると途中で文章を切って翻訳し始めることが頻発しました。

たとえば、こんな英文があったとします:

“Although many people believe that technology will solve all our problems, we must remember that it can also create new challenges that we haven’t even imagined yet.”

この場合、理想的には「多くの人がテクノロジーがすべての問題を解決すると信じていますが、私たちはそれがまだ想像もしていない新しい課題を生み出す可能性があることを忘れてはいけません」と訳されるべきです。

しかし実際の流れはこのようになってしまいます:

- 「多くの人がテクノロジーがすべての問題を解決すると信じています」(ここで一旦区切り)

- 少し間が空いて…

- 「私たちは覚えておく必要があります」(意味が繋がらない)

- 「それが新しい課題を作る可能性があることを」(急に話が変わった印象)

このように、長文を途中で区切ってしまうと、前後の文脈が失われて意味が通じにくくなります。

特にプレゼンテーションのように、論理的な展開が重要な場面では、この「ブツ切り翻訳」が致命的。話の流れが掴めず、結局何を言いたいのか分からないことが何度もありました。

テスト3:ネイティブとの実際の会話

最後に、アメリカ人の友人に協力してもらい、実際の会話で試しました。これが最も現実的な使用シーンです。

セッティング

- カフェで対面して会話

- お互いにAirPodsを装着(友人も同じ設定)

- 私:日本語、友人:英語で話す

結果:日常会話なら実用レベル

「今日は天気がいいね」「コーヒーにミルク入れる?」「週末は何をする予定?」といった短い日常会話は、かなりスムーズに翻訳されました。

特に印象的だったのは、お互いがAirPodsを使っている場合の快適さです。友人が英語で話す→私のAirPodsで日本語が聞こえる→私が日本語で返答する→友人のAirPodsで英語が聞こえる、という流れが比較的自然でした。

苦戦した場面

しかし、会話のテンポはどうしても遅くなります。普通の会話なら0.5秒以内に返答が返ってきますが、ライブ翻訳を介すると、こんな流れになります:

- 友人が英語で話す(3秒)

- 翻訳されるまで待つ(2秒)

- 私が内容を理解する(1秒)

- 日本語で返答する(3秒)

- 友人のAirPodsで翻訳される(2秒)

- 友人が理解する(1秒)

一往復で約12秒。普通の会話の約3倍(!)の時間がかかります。

友人からは「少し待ち時間が気になるけど、ジェスチャーとかで補えば全然使える」とのコメントがありました。確かに、翻訳待ちの間にうなずいたり、表情で反応したりすることで、不自然さは軽減されました。

翻訳ミスも発生

- ケース1:固有名詞の誤訳

友人が「I want to go to Mount Fuji(富士山に行ってみたい)」と言ったとき、AirPodsからは「山藤に行ってみたいです」と聞こえました。「Mount Fuji」を「山藤(やまふじ)」と誤認識したようです。 - ケース2:スラングの誤訳

友人が「That’s dope!(それ最高!)」と言ったとき、「それは麻薬です」と翻訳されました。確かに「dope」には「麻薬」という意味もありますが、この文脈では明らかにスラングの「すごい」という意味です。 - ケース3:早口への対応不足

友人が興奮して早口で話し始めたとき、翻訳がついていけず、何も聞こえてこない状態になりました。iPhoneの画面を見ると「…」と表示されたまま固まっていました。

結論

ネイティブの日常会話スピードに完全に追いつくのは、現状ではなかなか難しいというのが正直な感想です。相手に「ゆっくり、短く、はっきりと話してもらう」協力が必要になります。

ライブ翻訳の良い点|ここが素晴らしい

1. ハンズフリーで翻訳できる快適さ

従来の翻訳アプリは、スマホを手に持って、マイクに向かって話す必要がありました。しかしライブ翻訳なら、AirPodsを耳に入れるだけ。両手が自由に使えるので、ジェスチャーを交えた自然な会話ができます。

レストランで注文するときも、メニューを見ながら会話できるのは本当に便利でした。

2. プライバシー保護が徹底されている

すべての翻訳処理がiPhone内で完結し、インターネットに接続しなくても動作します。会話内容がクラウドサーバーに送られることがないため、ビジネスの機密情報や個人的な会話も安心です。

競合のGoogle翻訳やPocketalkなどのデバイスは、多くがクラウド処理を使うため、この点でAppleのアプローチは優れています。

3. 短い文章なら高精度

買い物、レストラン、ホテルのチェックインなど、定型的で短いやり取りなら、精度は十分実用レベルです。

4. ノイズキャンセリングとの連携

AirPodsのアクティブノイズキャンセリング(ANC)が、相手の生の声を小さくして、翻訳音声を際立たせてくれます。これにより、周囲が多少騒がしくても、翻訳された日本語に集中できました。

騒がしいカフェや駅構内でも、翻訳音声はクリアに聞こえました。

5. テキスト表示で確認できる

音声だけでなく、iPhoneの画面にリアルタイムでテキストが表示されるのも便利です。聞き取れなかった部分や、不安な翻訳内容を画面で確認できるのは、安心材料になりました。

ライブ翻訳の問題点|ここが残念

1. 時間ラグは避けられない

最大の問題は、やはり時間ラグです。英語と日本語の語順の違いにより、どうしても文末まで聞かないと翻訳できません。その結果、相手が話し終えてから2〜3秒後に翻訳が聞こえ始めます。

これが会話のテンポを大きく損なう、というのが残念なところ。常に「2〜3秒遅れで理解する」状態になり、リアルタイムな会話とは言えません。

2. 長文・複雑な文章に弱い

プレゼンテーションや講演のような、長く複雑な文章には明らかに弱いです。途中で文を区切ってしまうため、論理的な繋がりが失われます。

YouTubeやポッドキャストで勉強したい人には、正直おすすめできません。字幕機能を使った方が、はるかに正確で効率的です。

3. ネイティブの早口には追いつけない

ネイティブスピーカーが普通のスピードで話すと、翻訳が追いつかないことが頻繁にありました。

「ゆっくり、短く、明瞭に」話してもらう必要があるため、相手の協力が不可欠です。これは、急いでいる状況や、相手が忙しい場面では使いづらいです。

4. スラング・方言・固有名詞に弱い

標準的な言葉遣いには強いですが、スラング、方言、固有名詞、専門用語などには弱いです。

「That’s dope(最高)」が「麻薬」と訳されたり、地名が間違って認識されたりするのは、実用上の大きな障害でした。

5. バッテリー消費が激しい

ライブ翻訳はiPhoneのAIプロセッサ(Neural Engine)をフル稼働させるため、バッテリー消費が激しいです。

30分の会話で、iPhoneのバッテリーが約15%も減りました。長時間使う場合は、モバイルバッテリー必須です。

どんな場面で使える?|実用シーン別評価

○ おすすめできる場面

| シーン | 評価 | コメント |

|---|---|---|

| 海外旅行(買い物・レストラン) | ★★★★☆ | 短い定型文が多いため、実用レベル |

| ホテルのチェックイン | ★★★★☆ | 必要な情報が決まっているため使いやすい |

| タクシーでの行き先指示 | ★★★★☆ | 簡潔な会話で済むため問題なし |

| 道を尋ねる | ★★★★☆ | 短いやり取りで完結するため便利 |

| カジュアルな雑談 | ★★★☆☆ | テンポは遅いが、相手が理解してくれれば使える |

△ 使えなくはないが注意が必要

| シーン | 評価 | コメント |

|---|---|---|

| ビジネス会議 | ★★☆☆☆ | 専門用語や複雑な議論には不向き |

| 医療機関での受診 | ★★☆☆☆ | 症状の正確な伝達には不安が残る |

| 法的手続き | ★☆☆☆☆ | 誤訳のリスクが高く、推奨できない |

| 緊急時 | ★★☆☆☆ | 時間ラグが命取りになる可能性 |

× おすすめできない場面

| シーン | 評価 | コメント |

|---|---|---|

| プレゼンテーション聴講 | ★☆☆☆☆ | 長文・複雑な論理展開に対応できない |

| 映画鑑賞 | ★☆☆☆☆ | 字幕の方が圧倒的に優れている |

| 語学学習 | ★☆☆☆☆ | 元の音声が聞こえにくく、学習には不向き |

| 電話会議 | ★☆☆☆☆ | FaceTime通話での精度が低い |

競合製品との比較|他の翻訳デバイスとどう違う?

vs. Pocketalk(ポケトーク)

Pocketalkの利点

- 対応言語が82言語と圧倒的に多い

- 翻訳専用機なので操作がシンプル

- グローバルSIMで世界中どこでも使える

AirPodsの利点

- ハンズフリーで使える

- プライバシーが保護される(オンデバイス処理)

- 既にiPhoneとAirPodsを持っているなら追加費用ゼロ

- 音楽やその他の機能も使える多機能性

vs. Google翻訳アプリ(Pixel Buds連携)

Google翻訳の利点

- 対応言語が多い(100言語以上)

- 無料で使える

- AndroidでもiPhoneでもOK

AirPodsの利点

- Apple製品同士の連携がスムーズ

- オンデバイス処理でプライバシー保護

- AirPodsの高品質な音質とノイズキャンセリング

用途に合わせて選びたい

- 多言語対応が必須→ PocketalkやGoogle翻訳

- iPhoneユーザーで手軽に試したい→ AirPodsライブ翻訳

- ビジネスやプライバシー重視→ AirPodsライブ翻訳

翻訳精度を上げるコツ|実践的なテクニック

1. 相手に協力してもらう

- ゆっくり話してもらう

- 一文を短くしてもらう(15語以内が理想)

- 明瞭に発音してもらう

- スラングや方言を避けてもらう

最初に「翻訳アプリを使っているので、ゆっくり話してもらえますか?」と伝えるだけで、成功率が大幅に上がります。

2. 静かな環境で使う

騒音が多い場所では、マイクが相手の声を正確に拾えません。可能な限り、静かな場所で使いましょう。

どうしても騒がしい場所で使う場合は、iPhoneを相手の口元のほうに近づけると精度が向上します。

3. バッテリー残量を確認

iPhoneのバッテリーが20%を切ると、省電力モードが作動し、翻訳処理が遅くなったり、精度が落ちたりします。

翻訳を使う前に、iPhoneのバッテリーが40%以上あることを確認しましょう。

4. 言語データを最新に保つ

iOSやAirPodsのアップデートで、翻訳精度が改善されることがあります。常に最新のソフトウェアを使うようにしましょう。

5. 画面のテキストも活用する

音声だけに頼らず、iPhoneの画面に表示されるテキストも確認しましょう。聞き間違いを防げます。

まとめ|買うべきか、待つべきか

こんな人には今すぐおすすめ

- 既にiPhone 15 Pro以降とAirPodsを持っている(追加費用ゼロ)

- 海外旅行によく行き、基本的な会話ができれば十分

- プライバシーを重視し、クラウド翻訳を避けたい

- 新しい技術を試すのが好きで、多少の不便は気にならない

こんな人は様子見がおすすめ

- ビジネスや専門的な会話での使用を想定している

- 完璧な翻訳精度を求めている

- 長時間の会議やプレゼンテーション聴講に使いたい

- ネイティブとの高速な会話を期待している

結論|実用レベルだが、過度な期待は禁物

正直に言って、現時点でのライブ翻訳機能は「革命的」というよりは「便利な補助ツール」というレベルです。

海外旅行での買い物やレストラン、簡単な道案内などの場面では、間違いなく役立ちます。しかし、時間ラグ、翻訳ミス、長文への弱さといった課題は、現時点では解決されていません。

とはいえ、AI技術は急速に進化しており、2〜3年後には、本当の意味で「リアルタイム翻訳」と呼べるレベルに到達しているかもしれません。

既にiPhone 15 Pro以降とAirPods Proを持っている方は、追加費用なしで試せるので、ぜひ一度体験してみることをおすすめします。

AirPodsのおすすめ周辺機器・アクセサリー

▶︎ AirPods Pro 3用の最新おすすめケースを徹底解説

▶︎ AirPodsのイヤーチップや交換時期を徹底解説

▶︎ AirFly SEとProの違いを徹底解説

AirPodsの次世代モデルに関する最新情報・噂まとめ

▶︎ 次世代AirPods 5の噂まとめ

▶︎ 次世代AirPods Pro 4の噂まとめ

▶︎ 次世代AirPods Max 2の噂まとめ